你确定视频对面的是TA本人吗?“AI换脸”新骗术可以这样识破→

你确定视频对面的是TA本人吗?“AI换脸”新骗术可以这样识破→

你确定视频对面的是TA本人吗?“AI换脸”新骗术可以这样识破→

最近,人工智能换脸风靡网络

新技术带来欢乐的同时

也带来了名为“AI换脸诈骗”的新骗术

AI是如何做到“换脸”的?

这种骗术如何防?

↓↓↓

视频“变脸”相似度可达80%

这是一起AI换脸诈骗的案例

青岛的一名大学生

和他在网上认识的“女朋友”视频聊天

对方称需要资金周转

男孩打钱过去之后

发现竟然被诈骗了

有关部门通过取证发现

其实跟他聊天的并不是他的女朋友

对方是用虚拟的摄像头

通过AI换脸的功能跟他进行聊天

据了解

一个高配置的电脑

合成一段10秒的换脸视频只需要一两分钟

随着技术的发展

视频聊天的实时变脸也不是难事

换脸后的相似度可以达到80%

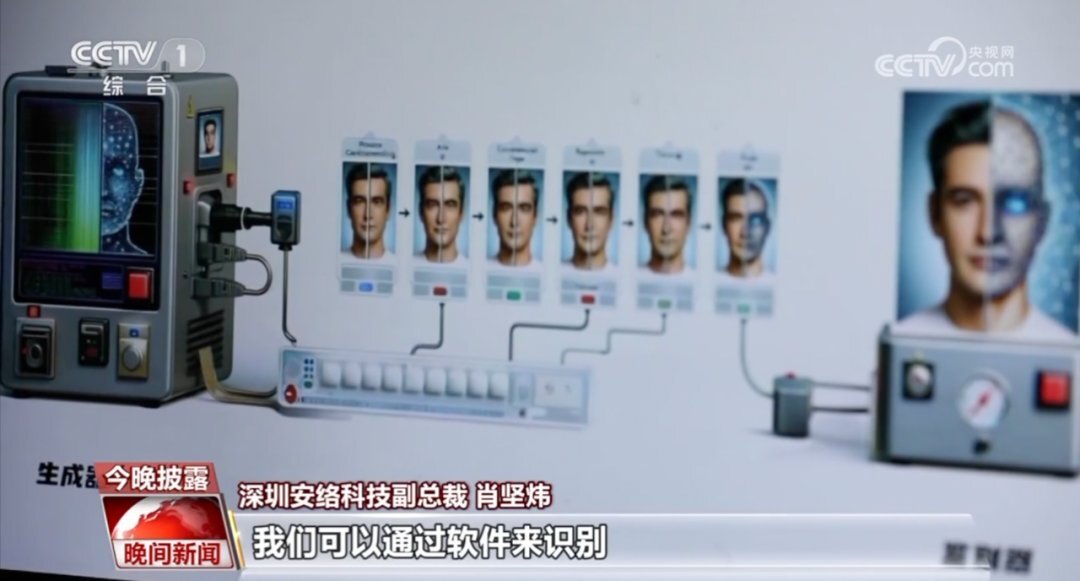

AI是如何做到在视频通话时换脸的?

据介绍,照片上传后

一般会有30秒钟左右的时间

对照片进行特征识别

然后进行建模

建模后就可以进行实时转换

不管是你的头像

还是在朋友圈的一张小照片

只要是照片都可以直接上传

然后进行特征的识别建模

AI生成的技术还在不断地更新迭代

比如性别的互换,声音的变换

都可以同步进行

由于算法是开源的

也就是说一个普通的工程师

就可以制作出一个变脸软件

这就导致在控制源头上十分困难

我们该如何识破此类骗术?

目前视频换脸的技术上并非无懈可击

视频沟通时的一些动作

就可以发现破绽

据介绍

如果让对方用手捂脸、动一动

就会干扰到图像的合成

从演示中可以看到

把手放上去后

演示者的眼睛、鼻子开始抖动↓

除了让对方在脸部做出一些动作来判断

专家介绍

AI合成软件的升级可能是飞速的

如果动作捕捉已经被避开

我们就需要通过更专业的软件来分辨

目前

这类鉴别软件对设备和周边的要求也比较高

使用起来并不普及

不过,让视频传播的网站或者社交软件

使用专业的鉴别软件来鉴定

再打上“AI制作”的标签

在现阶段不失为一个方法

预防“AI换脸诈骗”

大家还要加强对人脸、声纹、步态、指纹等

生物特征数据的安全防护

专家介绍

我们在使用互联网服务或在社会生活中

被要求输入人脸等生物特征数据的时候

要看对方收集我们的生物特征数据

是否合法、正当和必要

此外

国家也在通过多重手段防范“AI换脸诈骗”

近两年

相关部门先后出台了

《互联网信息服务深度合成管理规定》

《生成式人工智能服务管理暂行办法》等

有关政策文件

先后开展了“互联网深度合成算法备案”

“大语言模型算法备案”等有关工作

严厉打击利用AI换脸、变声等手段实施的

违法犯罪行为

初步遏制了滥用人工智能技术

特别是从事违法犯罪的势头

整体治理效果开始显现

也有力促进了人工智能技术的规范发展

擦亮双眼

谨防上当

(原标题:你确定视频对面的是TA本人吗?“AI换脸”新骗术可以这样识破→)

【责任编辑:谢镇蔚】

【内容审核:符 坚】